Quan niệm thông thường cho rằng, "Nếu bạn không muốn dữ liệu của mình bị sử dụng, hãy từ chối hoàn toàn."

Chúng tôi cho rằng, “Nếu dữ liệu của bạn đằng nào cũng được thu thập, thì việc tác động đến cách sử dụng dữ liệu đó sẽ hợp lý hơn.”

Câu hỏi không phải là: "Các công ty có nên nắm giữ dữ liệu của tôi không?" (Họ đã có rồi).

Câu hỏi thực sự là, "Liệu dữ liệu của tôi có nên được sử dụng để xây dựng trí tuệ nhân tạo tốt hơn cho tất cả mọi người?"

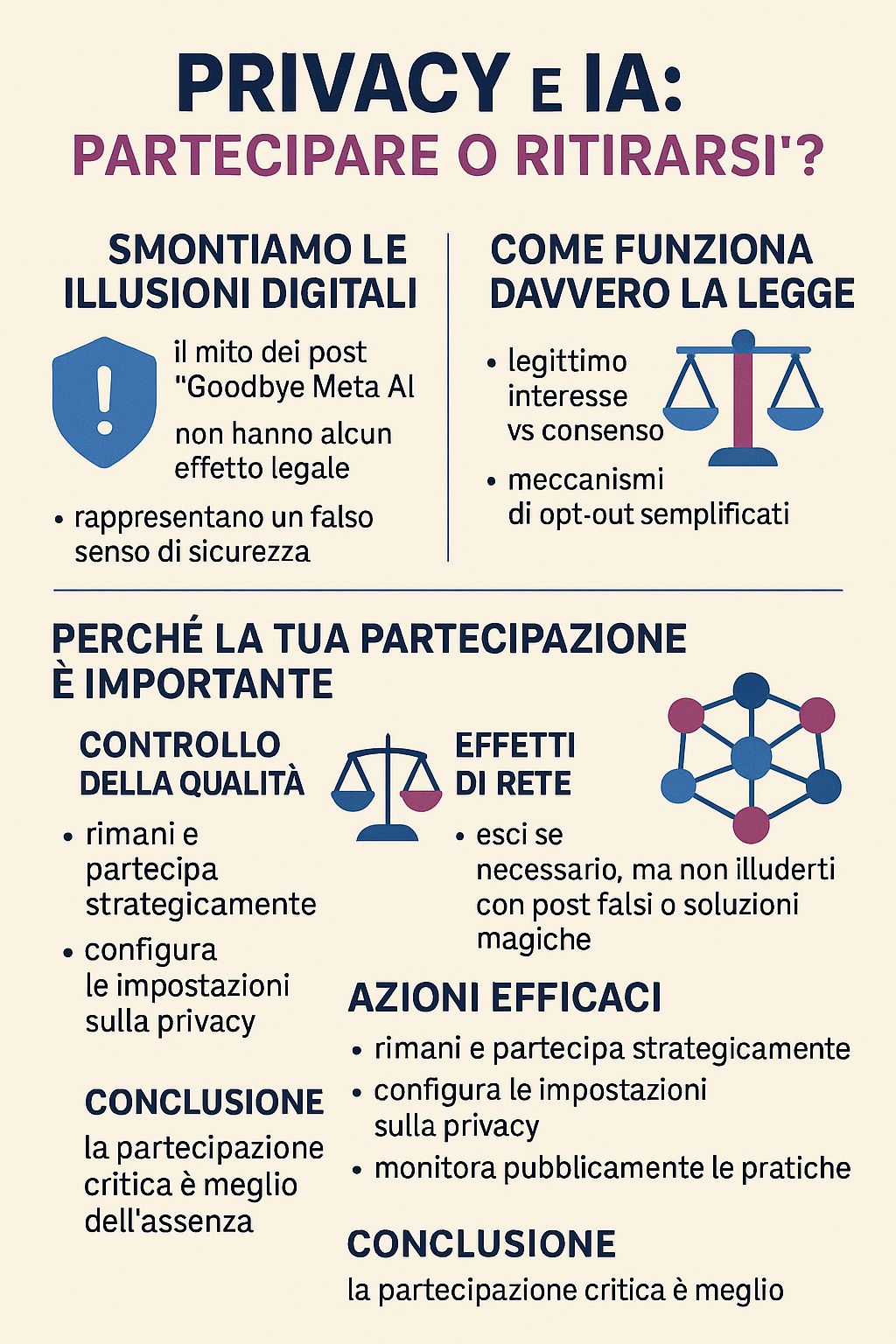

Trước khi xây dựng một lập luận nghiêm túc, điều quan trọng là phải bác bỏ một ảo tưởng nguy hiểm đang lan truyền trên mạng xã hội: những bài đăng lan truyền "Tạm biệt Meta AI" hứa hẹn sẽ bảo vệ dữ liệu của bạn chỉ bằng cách chia sẻ một tin nhắn.

Sự thật khó chịu: Những bài đăng này hoàn toàn giả mạo và có thể khiến bạn dễ bị tổn thương hơn .

Như chính Meta đã giải thích, "việc chia sẻ thông điệp 'Tạm biệt Meta AI' không cấu thành một hình thức phản đối hợp lệ." Những bài đăng này:

Sự lan truyền mạnh mẽ của những bài đăng này cho thấy một vấn đề sâu sắc hơn: chúng ta thích suy nghĩ đơn giản, viển vông hơn là những quyết định phức tạp, dựa trên thông tin đầy đủ. Việc chia sẻ một bài đăng khiến chúng ta cảm thấy được trao quyền mà không cần phải nỗ lực tìm hiểu thực sự về cách thức hoạt động của các quyền kỹ thuật số của mình.

Nhưng quyền riêng tư không được bảo vệ bằng meme . Nó được bảo vệ bằng kiến thức và hành động có ý thức.

Kể từ ngày 31 tháng 5 năm 2025, Meta đã triển khai một chế độ mới cho việc đào tạo AI, sử dụng "lợi ích hợp pháp" làm cơ sở pháp lý thay vì sự đồng ý. Đây không phải là một kẽ hở, mà là một công cụ pháp lý được quy định trong GDPR.

Lợi ích chính đáng cho phép các công ty xử lý dữ liệu mà không cần sự đồng ý rõ ràng nếu họ có thể chứng minh rằng lợi ích của họ không vượt quá quyền của người dùng. Điều này tạo ra một vùng xám, nơi các công ty "điều chỉnh luật" thông qua các đánh giá nội bộ.

Việc sử dụng dữ liệu không được ẩn danh tiềm ẩn "rủi ro cao về đảo ngược mô hình, rò rỉ bộ nhớ và lỗ hổng trích xuất dữ liệu". Sức mạnh tính toán cần thiết đồng nghĩa với việc chỉ những đối tượng có năng lực cao mới có thể khai thác hiệu quả dữ liệu này, tạo ra sự bất đối xứng mang tính hệ thống giữa người dân và các tập đoàn lớn.

Giờ đây, khi chúng ta đã làm rõ thực tế pháp lý và kỹ thuật, hãy cùng nhau xây dựng luận điểm ủng hộ sự tham gia chiến lược.

Khi những người có kiến thức chuyên môn từ chối tham gia, AI sẽ được đào tạo dựa trên dữ liệu từ những người tiếp tục tham gia. Bạn muốn các hệ thống AI chủ yếu dựa vào dữ liệu từ những người:

Sai lệch trong trí tuệ nhân tạo xảy ra khi dữ liệu huấn luyện không mang tính đại diện. Sự tham gia của bạn giúp đảm bảo:

Hệ thống trí tuệ nhân tạo ngày càng được cải thiện khi quy mô và tính đa dạng tăng lên:

Nếu bạn sử dụng các tính năng được hỗ trợ bởi trí tuệ nhân tạo (tìm kiếm, dịch thuật, đề xuất, công cụ trợ năng), sự tham gia của bạn sẽ giúp cải thiện chúng cho tất cả mọi người, bao gồm cả những người dùng tương lai cần đến chúng nhất.

Quyền riêng tư của bạn không thay đổi đáng kể giữa việc chọn tham gia và không tham gia vào việc sử dụng AI. Cùng một dữ liệu đã được sử dụng để cung cấp năng lượng cho:

Điểm khác biệt nằm ở chỗ liệu dữ liệu này có góp phần cải thiện trí tuệ nhân tạo cho tất cả mọi người hay chỉ phục vụ lợi ích thương mại trước mắt của nền tảng đó.

Đây chính là lý do tại sao những người có trách nhiệm như bạn nên tham gia. Nghỉ hưu không làm dừng sự phát triển của AI, nó chỉ đơn giản là loại bỏ tiếng nói của bạn khỏi quá trình đó.

Hệ thống trí tuệ nhân tạo sẽ được phát triển bất kể điều gì xảy ra. Câu hỏi đặt ra là: có hay không có sự đóng góp của những người có khả năng suy xét thấu đáo những vấn đề này?

Điều đó dễ hiểu. Nhưng hãy xem xét điều này: bạn sẽ thích các hệ thống AI được xây dựng có hoặc không có sự đóng góp ý kiến của những người cùng chung quan điểm hoài nghi với bạn về các tập đoàn lớn hơn?

Sự hoài nghi của bạn chính là lý do tại sao sự tham gia đóng góp ý kiến mang tính phê bình của bạn lại có giá trị.

Trí tuệ nhân tạo đang trở thành hiện thực, dù bạn có tham gia hay không.

Lựa chọn của bạn không phải là liệu trí tuệ nhân tạo (AI) có được xây dựng hay không , mà là liệu AI được xây dựng đó có phản ánh các giá trị và quan điểm của những người suy nghĩ thấu đáo về những vấn đề này hay không.

Việc không tham gia cũng giống như không bỏ phiếu. Nó không ngăn cản cuộc bầu cử, mà chỉ có nghĩa là kết quả sẽ không tính đến sự đóng góp của bạn.

Trong một thế giới mà chỉ những người có năng lực tính toán cao mới có thể diễn giải và khai thác dữ liệu một cách hiệu quả, tiếng nói mang tính phê phán của bạn trong quá trình đào tạo có thể có tác động lớn hơn sự vắng mặt của bạn.

Hãy tiếp tục tham gia một cách chiến lược nếu:

Và trong khi đó:

Nhưng đừng tự lừa dối mình bằng những điều sau:

Việc bạn tự nguyện từ chối tham gia có tác động tối thiểu đến quyền riêng tư của bạn, nhưng việc từ chối tham gia lại có tác động thực sự đến tất cả mọi người.

Trong một thế giới nơi các hệ thống trí tuệ nhân tạo sẽ định hình dòng chảy thông tin, các quyết định và sự tương tác giữa con người và công nghệ, câu hỏi đặt ra không phải là liệu các hệ thống này có nên tồn tại hay không, mà là liệu chúng có nên bao gồm quan điểm của những người có tư duy sâu sắc và khả năng phê phán như bạn hay không.

Đôi khi, hành động quyết liệt nhất không phải là bỏ cuộc. Thường thì, điều quyết liệt nhất là ở lại và đảm bảo tiếng nói của mình được lắng nghe.

Vô danh

Vấn đề không phải là tin tưởng các công ty một cách mù quáng hay phớt lờ các vấn đề về quyền riêng tư. Vấn đề là nhận ra rằng quyền riêng tư không được bảo vệ bằng các meme , mà bằng sự tham gia có chiến lược và hiểu biết.

Trong một hệ sinh thái nơi sự bất đối xứng quyền lực rất lớn, tiếng nói phê phán của bạn trong quá trình huấn luyện AI có thể có tác động lớn hơn so với việc bạn im lặng phản đối.

Dù bạn lựa chọn thế nào, hãy lựa chọn một cách tỉnh táo, chứ không phải bị đánh lừa bởi ảo ảnh kỹ thuật số.

Một đoạn bày tỏ sự cảm thông cũng dành cho những "người ẩn dật về quyền riêng tư" — những tâm hồn thuần khiết tin rằng họ có thể hoàn toàn thoát khỏi sự theo dõi kỹ thuật số bằng cách sống ngoại tuyến như các nhà sư Tây Tạng vào năm 2025.

Cảnh báo trước: ngay cả khi bạn sống trong một căn nhà gỗ hẻo lánh ở dãy núi Dolomites, dữ liệu của bạn cũng đã có mặt ở khắp mọi nơi. Bác sĩ gia đình của bạn sử dụng hệ thống kỹ thuật số. Ngân hàng nơi bạn gửi củi theo dõi mọi giao dịch. Siêu thị địa phương có camera và hệ thống thanh toán điện tử. Ngay cả người đưa thư mang hóa đơn đến cho bạn cũng đóng góp vào bộ dữ liệu hậu cần dùng để cung cấp thông tin cho các thuật toán tối ưu hóa.

Việc hoàn toàn tách biệt khỏi thế giới kỹ thuật số vào năm 2025 về cơ bản có nghĩa là tự cô lập mình khỏi xã hội dân sự . Bạn có thể từ bỏ Instagram, nhưng bạn không thể từ bỏ chăm sóc sức khỏe, ngân hàng, giáo dục hoặc việc làm mà không gây ra những hậu quả nghiêm trọng đối với chất lượng cuộc sống của bạn.

Trong khi bạn đang xây dựng căn nhà chống sóng 5G của mình, dữ liệu của bạn vẫn tồn tại trong cơ sở dữ liệu của các bệnh viện, ngân hàng, công ty bảo hiểm, chính quyền địa phương và cơ quan thuế, và vẫn đang được sử dụng để đào tạo các hệ thống sẽ ảnh hưởng đến các thế hệ tương lai.

Nghịch lý người ẩn dật: Việc bạn tự cô lập mình không ngăn cản các hệ thống AI được huấn luyện bằng dữ liệu từ những người ít hiểu biết hơn, nhưng nó lại loại trừ bạn khỏi việc tác động đến sự phát triển của chúng theo hướng đạo đức hơn.

Về bản chất, bạn đã chinh phục được sự thuần khiết về mặt đạo đức của những người quan sát lịch sử từ bên ngoài, trong khi những người khác—kém hiểu biết hơn nhưng hiện diện nhiều hơn—lại là người viết nên luật chơi.

Dù bạn lựa chọn thế nào, hãy lựa chọn một cách tỉnh táo, chứ không phải bị đánh lừa bởi ảo ảnh kỹ thuật số.

Các bài báo được trích dẫn:

Những hiểu biết về GDPR và lợi ích hợp pháp:

Nguồn thông tin chính thức:

Để hành động cụ thể: Nếu bạn ở châu Âu, hãy kiểm tra các thủ tục từ chối chính thức với Cơ quan Bảo vệ Dữ liệu Ý. Để biết thông tin chung, hãy tham khảo cài đặt quyền riêng tư và điều khoản dịch vụ của nền tảng bạn đang sử dụng. Và hãy nhớ: không có bài đăng nào trên mạng xã hội có giá trị pháp lý.